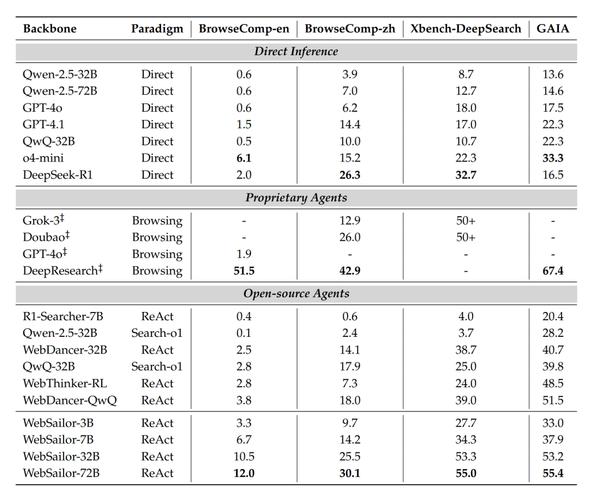

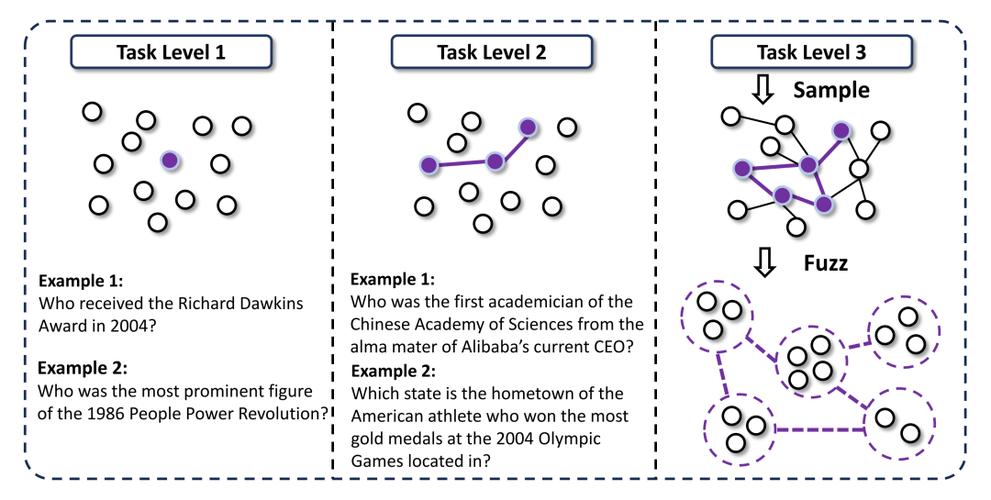

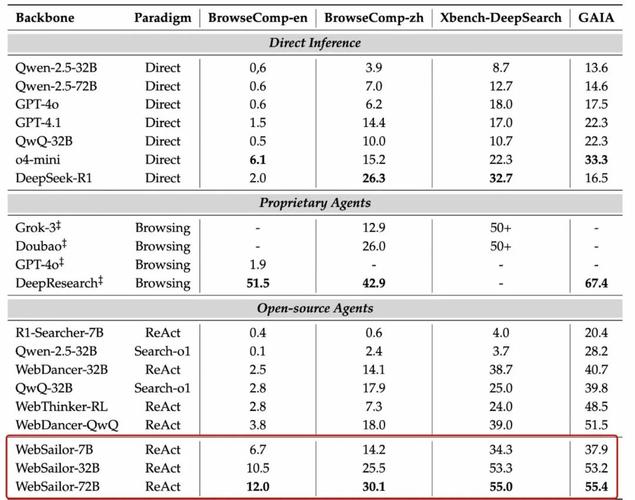

MaskSearch是阿里巴巴通义实验室推出的新型通用预训练框架,提升大型语言模型(LLM)的智能体搜索能力。通过检索增强掩码预测(RAMP)任务,让模型在输入文本中对关键信息掩码,借助外部知识库调用搜索工具预测被掩盖的片段,涵盖命名实体、日期、数字、本体知识等关键信息,增加任务难度,促使模型精细化处理信息。在生成监督微调(SFT)数据时,采用多智能体系统,包括规划者、重写者、观察者等角色,协同生成思维链数据,提升数据质量。训练方法结合了SFT和强化学习(RL),使用动态采样策略优化(DAPO)算法构建混合奖励系统,采用课程学习,按掩码数量分级样本难度,让模型逐步学习。

全部评论

留言在赶来的路上...

发表评论