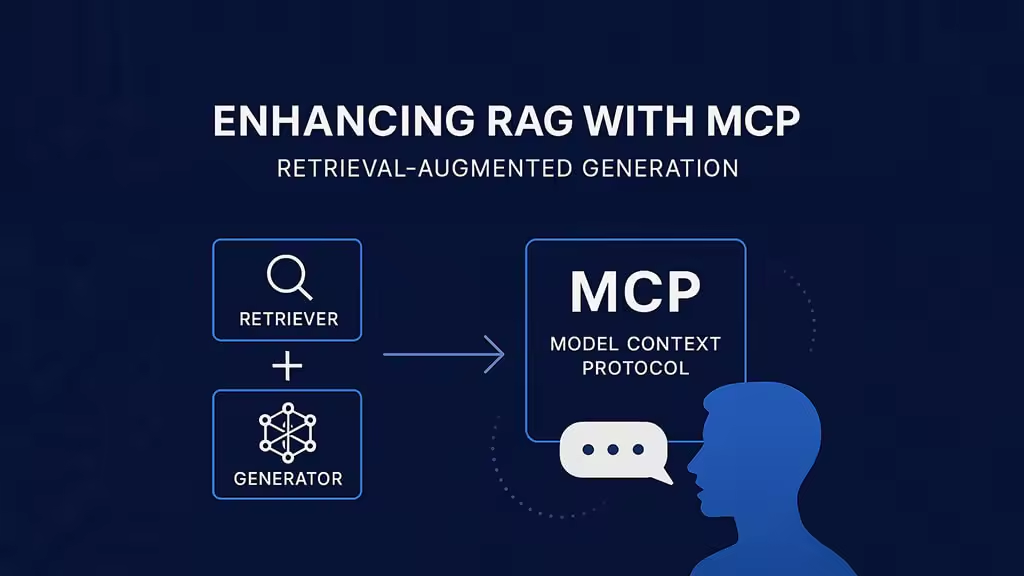

RAG 在 MCP 的支持下,可以彻底改变您与 AI 助手的沟通方式。它可以将您的 AI 从简单的文本生成器转变为能够像人类一样思考和处理信息的实时助手。两者的结合可以提高您的工作效率,并随着时间的推移提升您的效率。只需完成前面提到的几个步骤,任何人都可以使用 RAG 和 MCP 构建与现实世界连接的 AI 应用程序。现在,是时候通过设置您自己的 MCP 工具来赋予您的 LLM 超能力了。

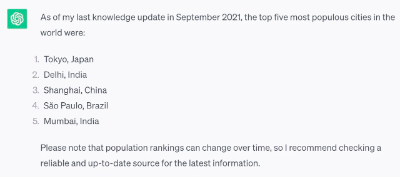

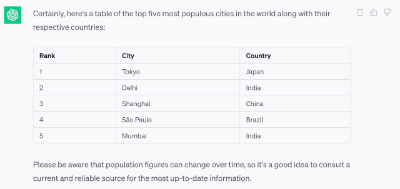

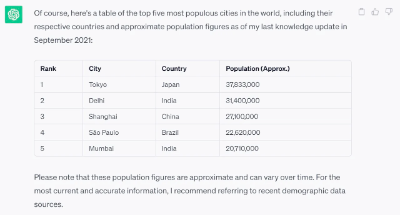

问题 1:RAG 与传统 LLM 的答案有何不同?

答:传统 LLM 的答案仅基于预先训练的知识,而这些知识可能已过时或不完整。RAG 通过在回答之前检索实时或外部数据(文档、API)来增强这一点,从而确保答案更准确、更及时。

问题 2:为什么我应该使用 MCP 来处理 RAG,而不是编写自定义代码?

答:MCP 无需手动对每个 API 或数据库集成进行硬编码。它提供了一种即插即用机制,可以公开 AI 模型可以根据上下文动态使用的工具,从而使 RAG 的实现更快、更可扩展且更易于维护。

问 3:我需要成为 AI 或 LangChain 专家才能将 RAG 与 MCP 结合使用吗?

答:完全不需要。只需具备基本的 Python 知识并按照分步设置,您就可以创建自己的 RAG 驱动的 MCP 服务器。LangChain 和 Cursor IDE 等工具使集成变得简单易行。

全部评论

留言在赶来的路上...

发表评论