浙大mf

-

发布了文章 2个月前

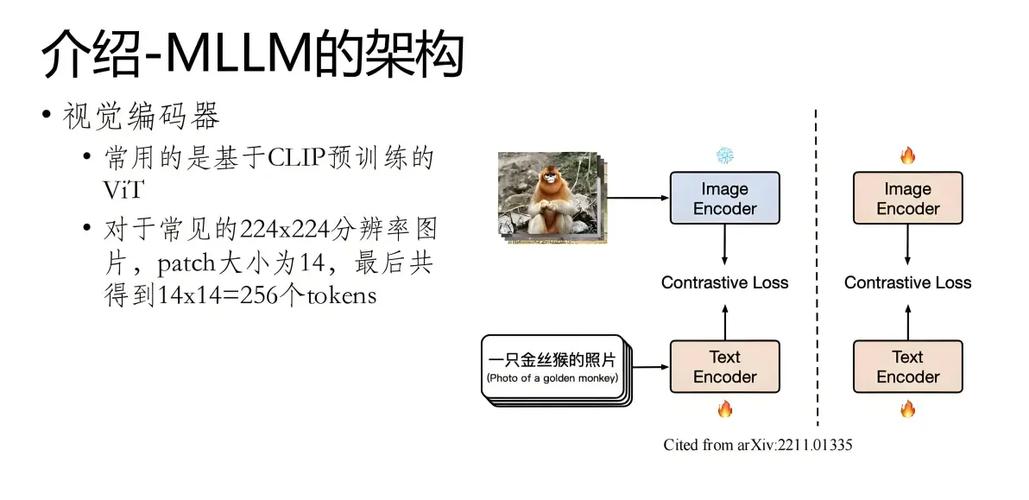

VLM-baidu09R1 – 浙大 Om AI Lab 推出的视觉语言模型

VLM-R1 是 Om AI Lab 推出的基于强化学习技术的视觉语言模型,通过自然语言指令精确定位图像中的目标物体,如根据描述“图中红色的杯子”找到对应的图像区域。模型基于 Qwen2.5-VL 架构,结合 DeepSee...

-

发布了文章 2个月前

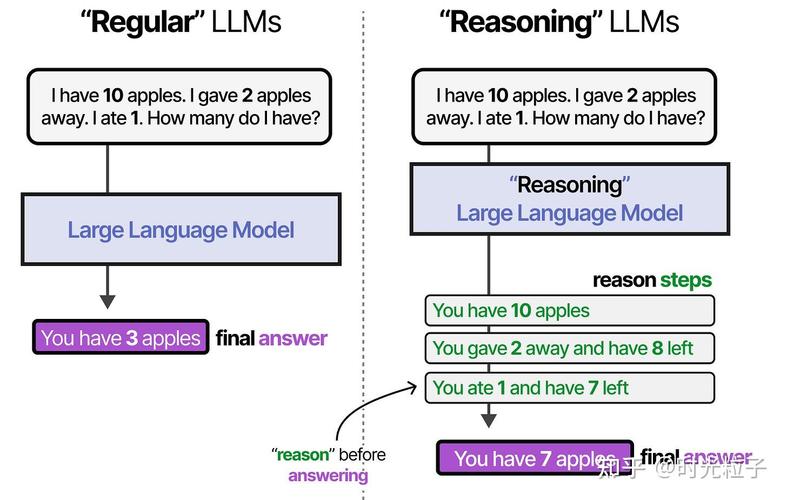

Embodied Reasoner – 浙大联合阿里等机构推出的具身交互推理模型

Embodied Reasoner是浙江大学、中国科学院软件研究所、阿里巴巴集团等机构推出的新型的具身交互推理模型,基于视觉搜索、推理和行动协同完成复杂任务。模型基于模仿学习、自我探索和自我修正的三阶段训练方法,生成多样化的...

没有更多内容