deepspec

-

发布了文章 2个月前

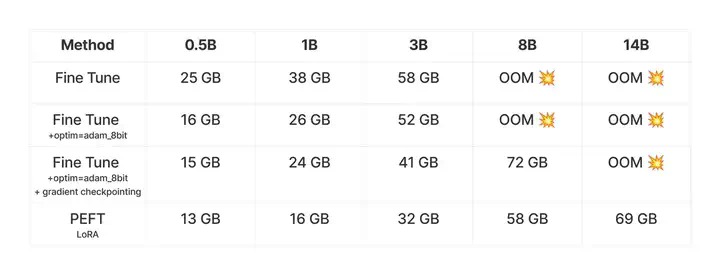

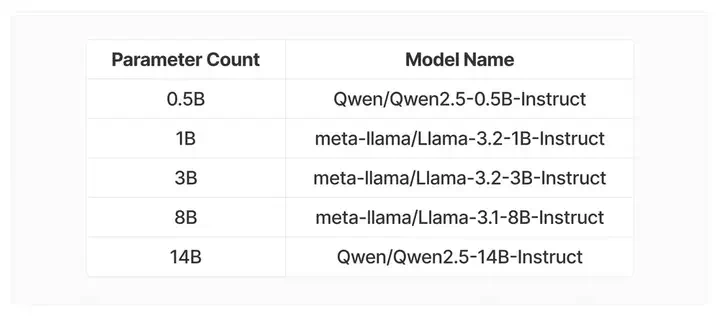

DeepSeek用的GRPO占用大量内存?有人给出了些破解方法

DeepSeek用的GRPO占用大量内存?有人给出了些破解方法 RTX 3080 移动版能训练哪种大模型?本文为那些 GPU 资源有限时使用 GRPO 训练的开发者提供了宝贵的指导。自 DeepSeek-R1 发布以来...

-

发布了文章 2个月前

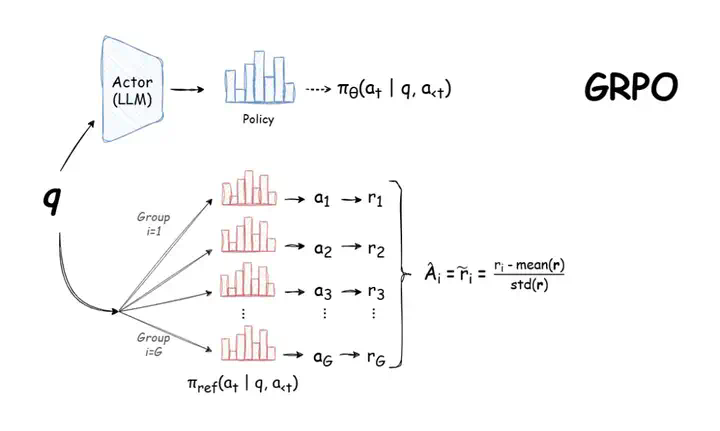

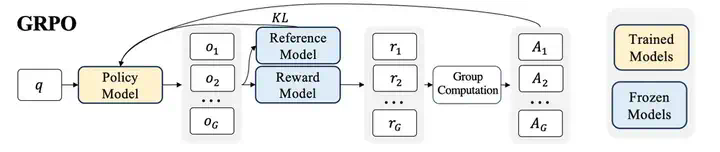

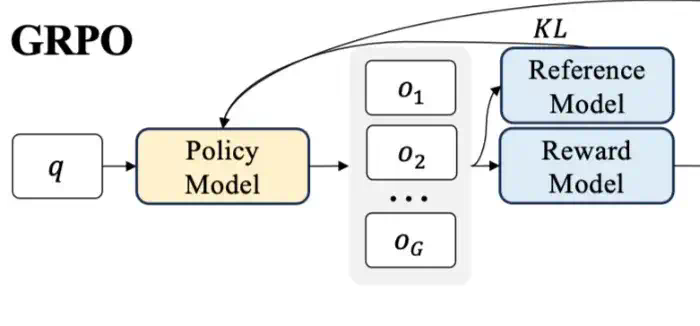

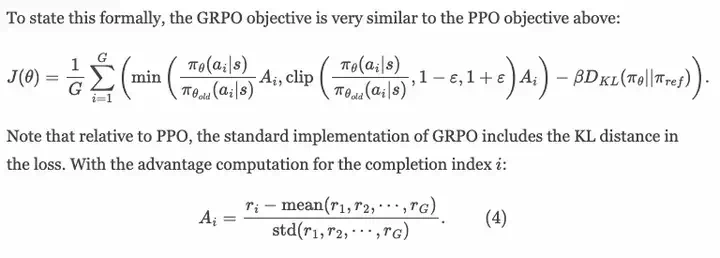

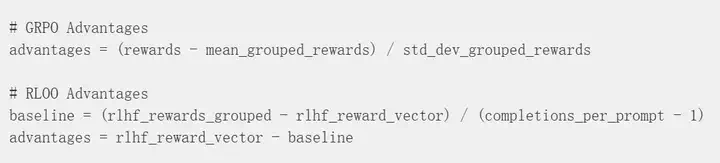

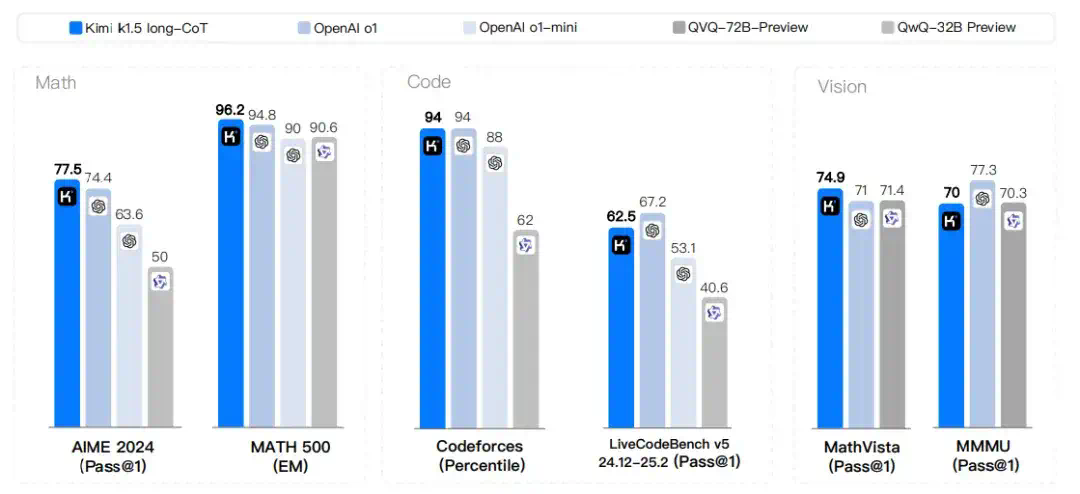

DeepSeek用的GRPO有那么特别吗?万字长文分析四篇精品论文

DeepSeek用的GRPO有那么特别吗?万字长文分析四篇精品论文 本文详细解读了 Kimi k1.5、OpenReasonerZero、DAPO 和 Dr. GRPO 四篇论文中的创新点,读完会对 GRPO 及其改进...

-

发布了文章 2个月前

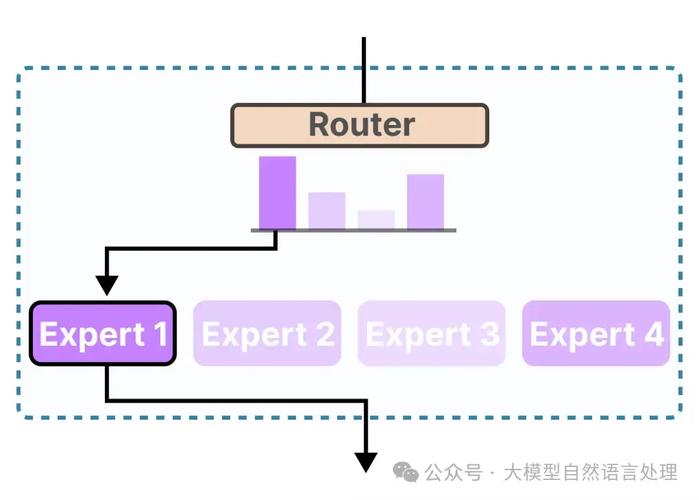

DeepEP – DeepSeek 开源的专家并行通信库,专为 MoE 训练和推理设计

DeepEP 是 DeepSeek 开源的首个专为混合专家模型(MoE)训练和推理设计的开源 EP(专家并行)通信库。提供了高吞吐量和低延迟的全对全 GPU 内核,支持节点内和节点间的 NVLink 和 RDMA 通信。...

没有更多内容