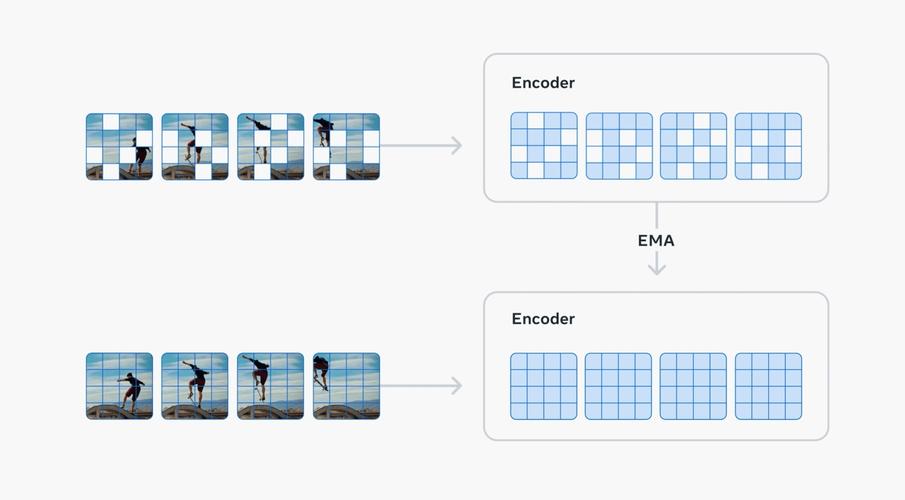

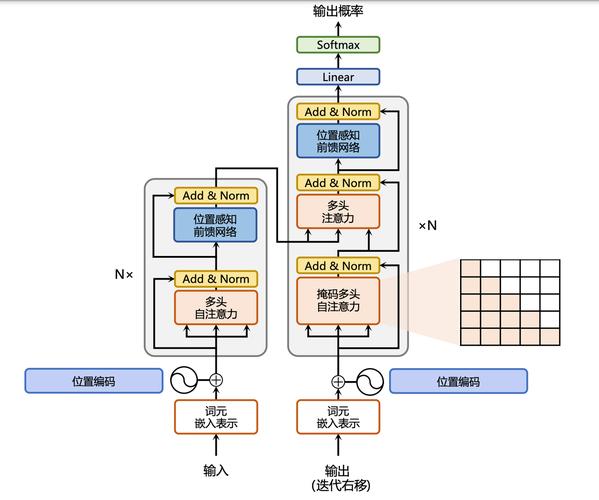

V-JEPA(Video Joint-Embedding Predictive Architecture,视频联合嵌入预测架构)是由Meta的研究人员推出的一种新型的视频自监督学习方法,它专注于通过特征预测来学习视频的视觉表示。这种方法的核心思想是让模型能够预测视频中一个区域(称为目标区域y)的特征表示,这个预测基于另一个区域(称为源区域x)的特征表示。这种预测过程是在没有外部监督(如标注或预训练图像编码器)的情况下进行的,完全依赖于视频数据本身的结构和内容。

V-JEPA 的与众不同之处在于它的自我监督学习方法,该方法可以预测抽象特征空间内视频的缺失部分,而不是填充缺失像素的生成方法。该技术不是通过手动标注,而是通过像人类一样的被动观察来建立对视频片段的概念理解。

V-JEPA的工作原理基于自监督学习,它通过预测视频帧之间的特征表示来训练模型。

以下是V-JEPA工作流程的详细步骤:

全部评论

留言在赶来的路上...

发表评论