UniTalker是推出的音频驱动3D面部动画生成模型,能根据输入的音频生成逼真的面部动作。采用统一的多头架构模型,用带有不同标注的数据集,支持多语言和多种音频类型的处理,包括语音和歌曲。不管是清晰的人声,还是带点噪音的歌声,UniTalker 都处理得很好。UniTalker可以同时给多个角色生成面部动作,不需要重新设计,非常灵活方便。

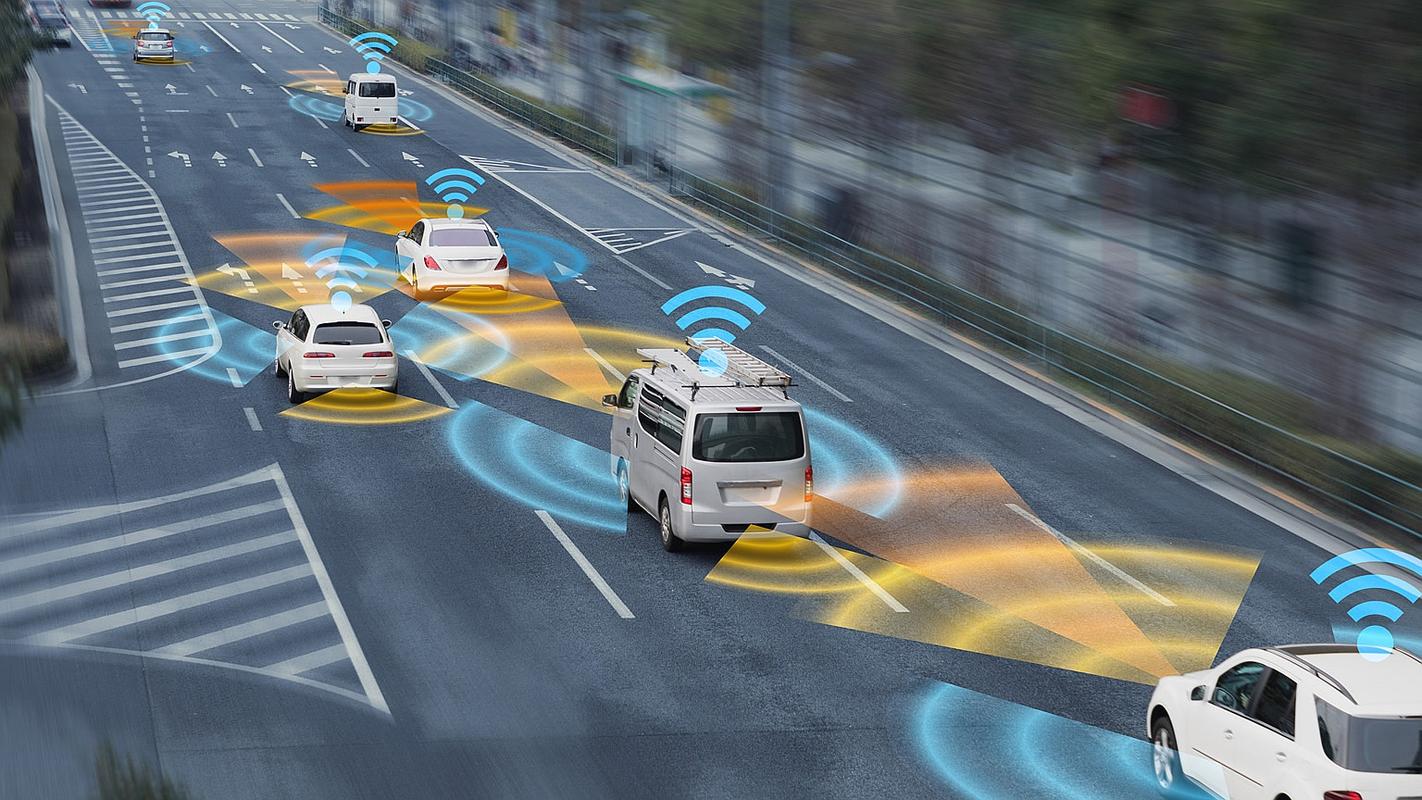

(图片来源网络,侵删)

UniTalker是推出的音频驱动3D面部动画生成模型,能根据输入的音频生成逼真的面部动作。采用统一的多头架构模型,用带有不同标注的数据集,支持多语言和多种音频类型的处理,包括语音和歌曲。不管是清晰的人声,还是带点噪音的歌声,UniTalker 都处理得很好。UniTalker可以同时给多个角色生成面部动作,不需要重新设计,非常灵活方便。

全部评论

留言在赶来的路上...

发表评论