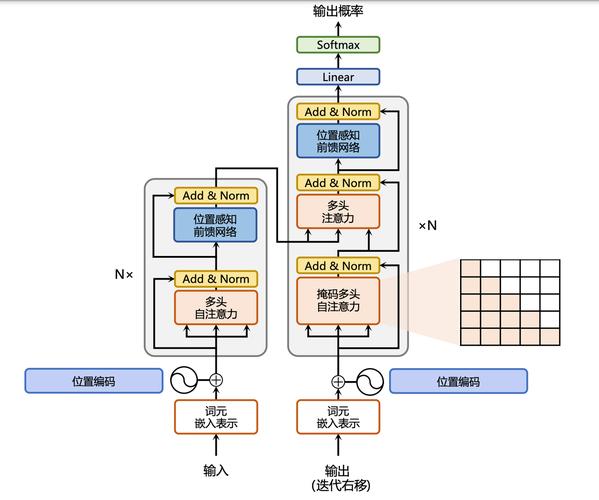

Self-Taught Evaluators是一种新型的模型评估方法,基于自我训练的方式提高大型语言模型(LLM)的评估能力,无需人工标注数据。从未经标记的指令开始,用迭代自我改进方案生成对比模型输出。用LLM作为裁判,生成推理轨迹和最终判断。在每次迭代中重复,用改进的预测训练模型。在实验中,Self-Taught Evaluators提高基于Llama3-70B-Instruct模型的评估准确性,从75.4提高到88.3,在多数投票的情况下达到88.7,超越常用的LLM裁判如GPT-4,与用人工标注数据训练的顶级奖励模型性能相当。

全部评论

留言在赶来的路上...

发表评论