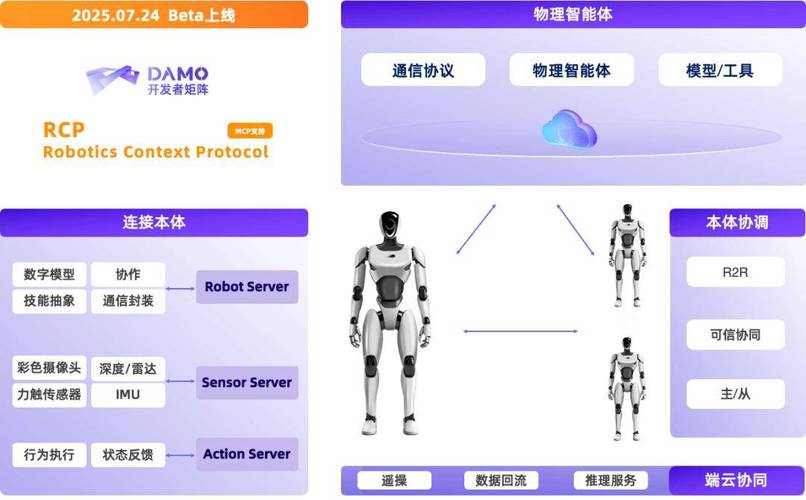

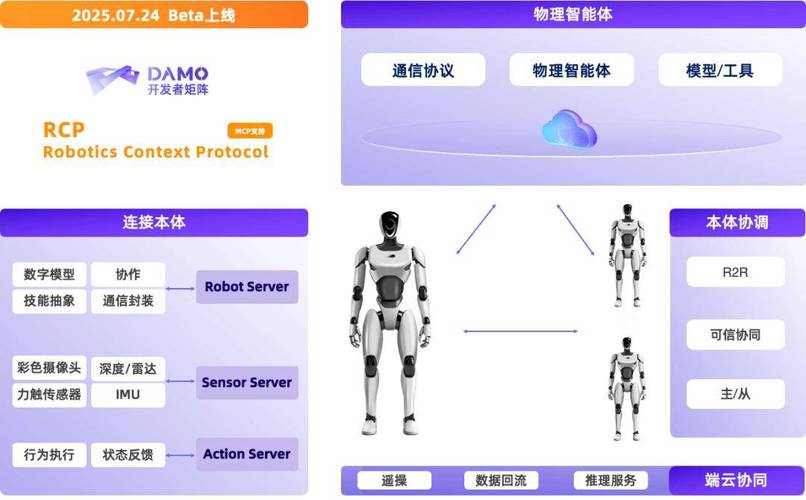

RynnVLA-001 是阿里达摩院推出的视觉-语言-动作模型。模型通过在大量第一人称视角的视频上进行预训练,学习人类操作技能,并隐式迁移到机器人手臂的操控中。模型结合视频生成技术和变分自编码器(VAE),能生成连贯、平滑的动作序列,更接近人类动作。模型将“下一帧预测”和“下一动作预测”统一到一个 Transformer 架构中,显著提升机器人在复杂任务中的成功率和指令遵循能力。

RynnVLA-001 是阿里达摩院推出的视觉-语言-动作模型。模型通过在大量第一人称视角的视频上进行预训练,学习人类操作技能,并隐式迁移到机器人手臂的操控中。模型结合视频生成技术和变分自编码器(VAE),能生成连贯、平滑的动作序列,更接近人类动作。模型将“下一帧预测”和“下一动作预测”统一到一个 Transformer 架构中,显著提升机器人在复杂任务中的成功率和指令遵循能力。

全部评论

留言在赶来的路上...

发表评论