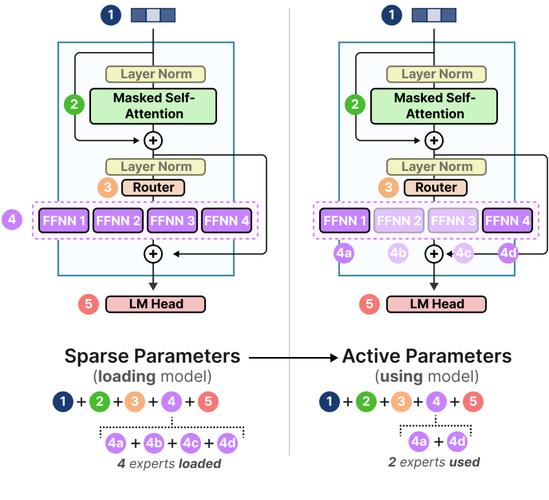

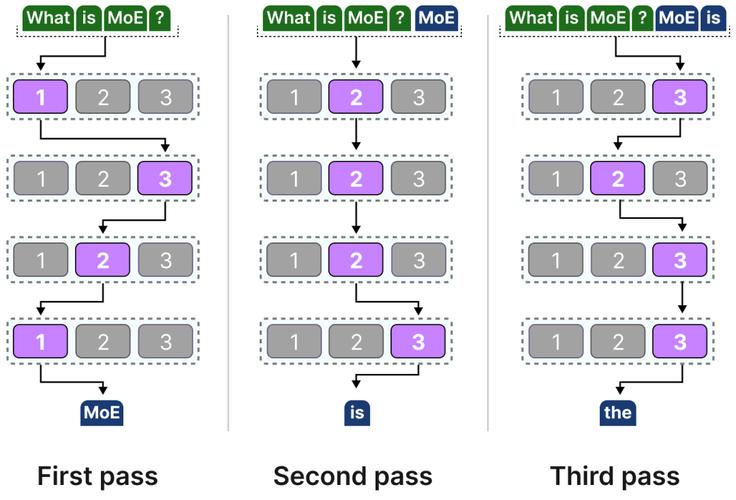

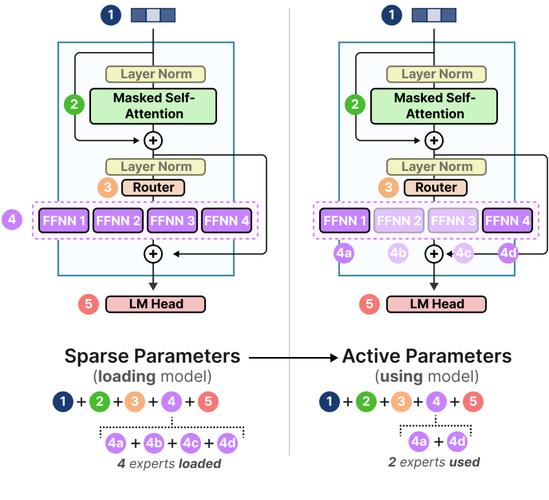

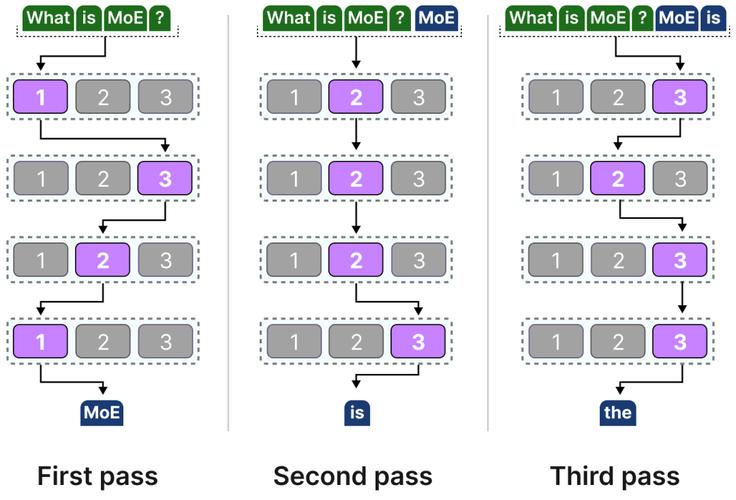

OLMoE(Open Mixture-of-Experts Language Models)是一个完全开源的大型语言模型,基于混合专家(MoE)架构。OLMoE基于5万亿个token进行预训练,拥有70亿总参数和10亿活跃参数。模型在每一层中只有一部分专家根据输入被激活,比传统密集模型更高效,降低计算成本。OLMoE的设计在保持高性能的同时,训练速度更快,推理成本更低,能与更大、更昂贵的模型竞争。

OLMoE(Open Mixture-of-Experts Language Models)是一个完全开源的大型语言模型,基于混合专家(MoE)架构。OLMoE基于5万亿个token进行预训练,拥有70亿总参数和10亿活跃参数。模型在每一层中只有一部分专家根据输入被激活,比传统密集模型更高效,降低计算成本。OLMoE的设计在保持高性能的同时,训练速度更快,推理成本更低,能与更大、更昂贵的模型竞争。

全部评论

留言在赶来的路上...

发表评论