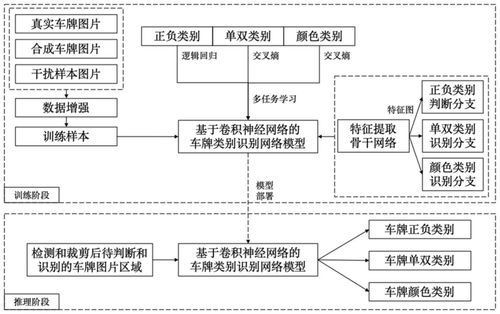

NMT(No More Tuning)是UC Berkeley和阿里巴巴集团联合推出的多任务学习框架,能解决多任务学习中不同任务优先级优化的问题。NMT将多任务学习问题转化为约束优化问题,将高优先级任务的性能作为约束条件,在优化低优先级任务时保持高优先级任务的性能。NMT基于拉格朗日微分乘数法,将约束问题转化为无约束问题,并用梯度下降法求解,避免传统方法中复杂的超参数调整过程。NMT框架易于与基于梯度下降的多任务学习方法集成,无需额外的超参数,有效简化模型训练过程,提高了高优先级任务的性能。

(图片来源网络,侵删)

(图片来源网络,侵删)

全部评论

留言在赶来的路上...

发表评论