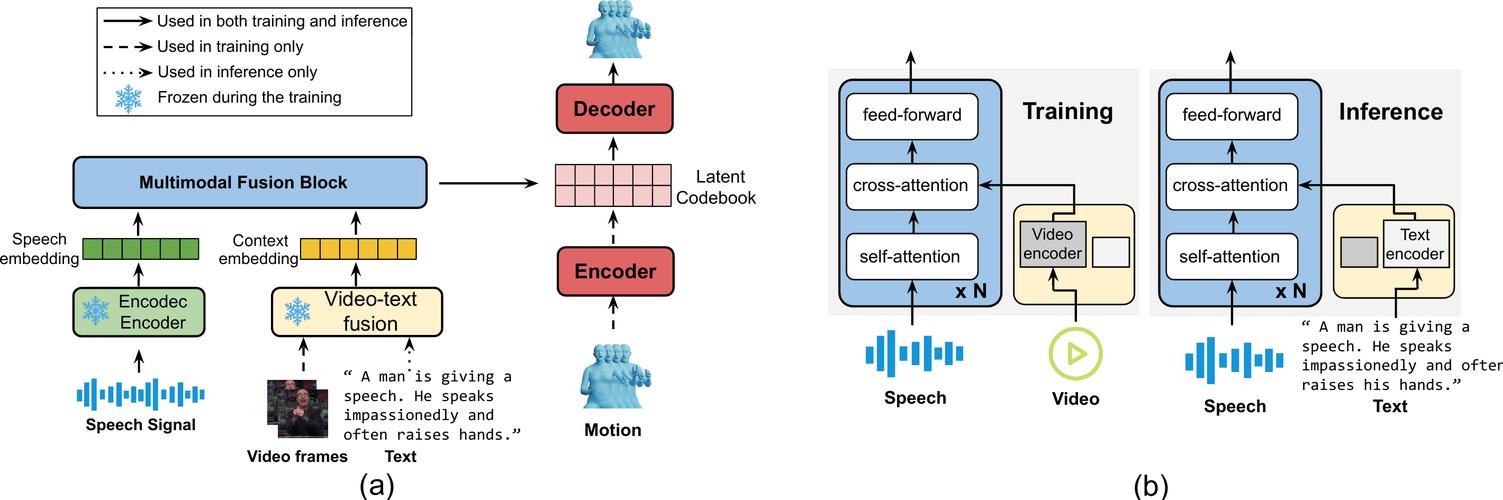

Motion Anything 是澳大利亚国立大学、悉尼大学、腾讯、麦吉尔大学、京东等机构推出的多模态运动生成框架,根据文本、音乐或两者的组合生成高质量、可控的人类运动。Motion Anything引入基于注意力的掩码建模方法,实现对运动序列中关键帧和动作的细粒度控制,解决现有方法无法根据条件优先生成动态内容的问题。框架基于时间自适应和空间对齐变换器,有效整合多种模态条件,提升生成运动的连贯性和多样性。同时推出 Text-Music-Dance (TMD) 数据集,包含 2153 对文本、音乐和舞蹈的配对样本,为多模态运动生成的研究提供了新的基准。

全部评论

留言在赶来的路上...

发表评论