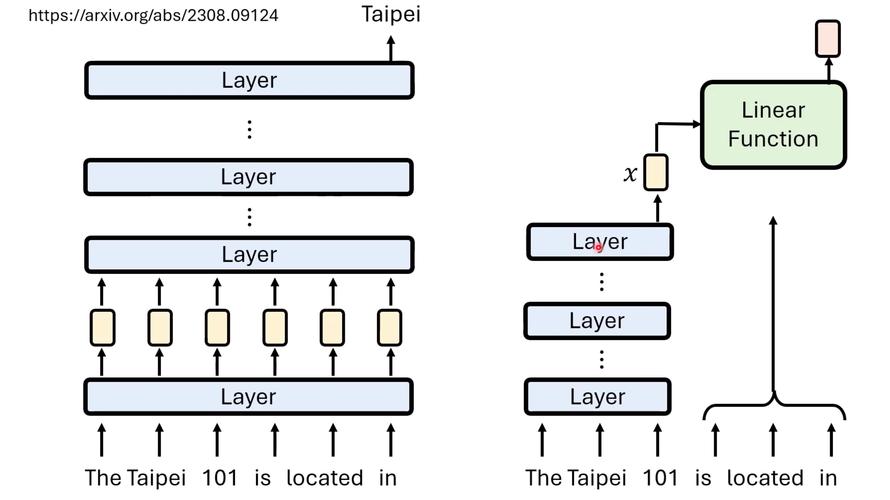

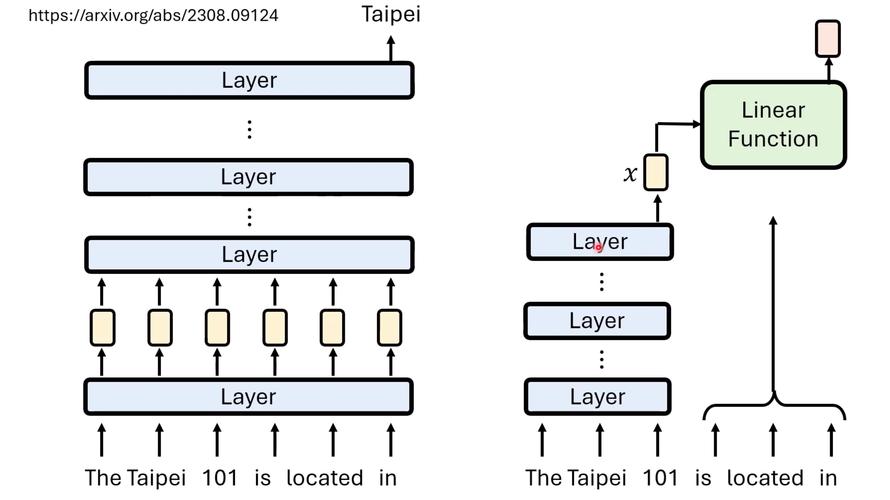

LayerSkip是一种用在加速大型语言模型(LLMs)推理过程的技术。基于在训练阶段应用层dropout和早期退出损失,让模型在推理时从早期层开始更准确地退出,不需要遍历所有层。提高模型的推理速度,减少计算资源的消耗。LayerSkip引入一种自我推测解码方法,方法基于早期层退出生成令牌,用剩余层进行验证和纠正,提高解码的效率,内存占用更少,从共享计算和激活中获益。LayerSkip在多种任务上显示出显著的速度提升,如文档摘要、编程任务和语义解析等,保持较高的准确性。

LayerSkip是一种用在加速大型语言模型(LLMs)推理过程的技术。基于在训练阶段应用层dropout和早期退出损失,让模型在推理时从早期层开始更准确地退出,不需要遍历所有层。提高模型的推理速度,减少计算资源的消耗。LayerSkip引入一种自我推测解码方法,方法基于早期层退出生成令牌,用剩余层进行验证和纠正,提高解码的效率,内存占用更少,从共享计算和激活中获益。LayerSkip在多种任务上显示出显著的速度提升,如文档摘要、编程任务和语义解析等,保持较高的准确性。

全部评论

留言在赶来的路上...

发表评论