Link:

Link:

DreamActor-M1 主要由五个部分组成,它们共同将一张照片转换成动态逼真的视频。这些部件根据其功能可分为三组:

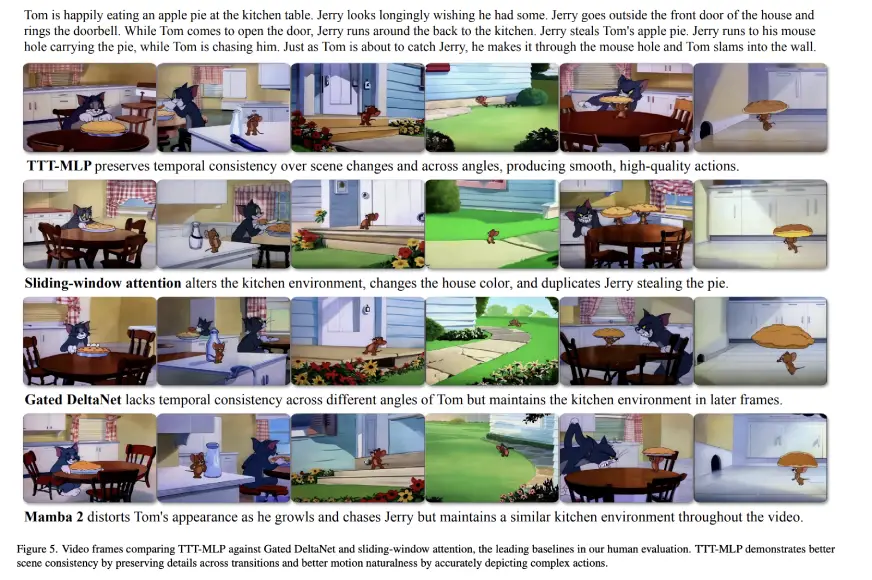

这项技术对于制作电影或有趣的视频来说就像魔法一样神奇。想象一下,电影制片人用它来创造场景,而不需要演员来完成每个动作。研究人员对 DreamActor-M1 进行了多项基准测试,发现它几乎在所有方面都优于现有方法:

与 DreamActor-M1 一样,Meta 的 也是近来大受欢迎的图像视频生成器。这两种模式都是通过视频或运动特征等驱动信号,将单个输入图像转换成动画。它们的共同目标都是以自然可信的方式为静态肖像制作动画,因此具有直接的可比性。以下是两个模型的并排比较:

虽然 DreamActor-M1 和 MoCha 擅长的领域略有不同,但它们都代表了个性化视频生成领域的巨大进步。SadTalker 和 EMO 等模型也属于这一领域,但它们主要侧重于面部表情,有时会牺牲动作的流畅性。HoloTalk 是另一种新兴模式,具有很高的唇部同步精度,但不能像 DreamActor-M1 那样提供全身控制。相比之下,DreamActor-M1 集面部逼真度、肢体动作和姿势适应性于一身,是目前最全面的解决方案之一。

DreamActor-M1 虽然令人兴奋,但它也引发了严重的伦理问题,因为它只用一张照片就能制作出逼真的视频。以下是一些关键问题:

DreamActor-M1 是人工智能动画领域的一次巨大飞跃,为已经蓬勃发展的 GenAI 领域带来了又一次突破。它将复杂的运动建模和扩散变换器与丰富的视觉理解融为一体,将静态照片转化为富有表现力的动态视频。虽然它具有创造性的潜力,但在使用时应提高认识并承担责任。随着研究的不断发展,DreamActor-M1 已成为人工智能如何在下一代媒体制作中实现逼真性和创造性的有力范例。

全部评论

留言在赶来的路上...

发表评论