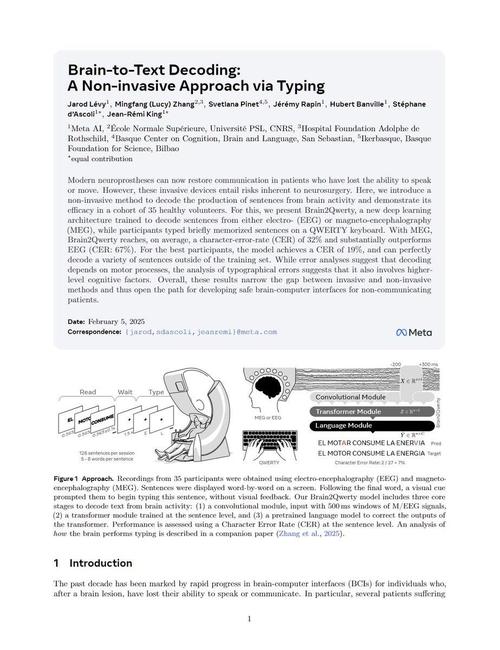

该图显示了 MoCha 和三个基准模型(Hallo3、SadTalker、AniPortrait)在唇部同步、表情、动作、文本对齐和视觉质量五个方面的人类评估得分。MoCha 的得分始终高于 3.7,优于所有基线模型。SadTalker 和 AniPortrait 在动作自然度方面得分最低,这是因为它们只有有限的头部动作。由于不支持文本输入,这两个软件的文本对齐度标记为不适用。总的来说,MoCha 的输出在所有类别中都最接近电影的真实感。

同步精度

以下模型通过两个参数进行了测试:

MoCha 的唇部同步最准确,音频和嘴部动作之间的混淆最少。

去掉关键特征会怎样?

研究人员还测试了如果移除模型的某些重要部分会发生什么情况。

虽然目前还没有公开的演示或 GitHub 仓库,但官方上分享的视频确实令人印象深刻。尤其令我印象深刻的是

如果将来这些功能可以通过应用程序接口(API)或开放模型实现,那么它将为电影制作人、教育工作者、广告商和游戏开发者带来一大批工具。

在过去的一年里,我们看到了人工智能生成内容的重大飞跃–从图像扩散模型到大型语言代理。但是,MoCha 带来了新的东西:从脚本到屏幕的生成更近了一步。

无需关键帧。没有手动动画。只有自然语言和声音。

如果 MoCha 未来的迭代版本能在此基础上增加更长的场景、背景元素、情感动态和实时响应能力,那么它将改变各行各业创建内容的方式。就目前而言,这是一项了不起的研究成果。绝对值得密切关注。

By the way,Meta 发布的这篇关于 Mocha 的研究论文参与者名单中,几乎清一色的华人姓名……牛逼普拉斯!

全部评论

留言在赶来的路上...

发表评论