分类:自然语言处理

本文介绍了一种新的语言模型 (LLM) 学习范式“模型链”(CoM),它将因果关系以链的形式集成到隐藏状态中,从而提升了扩展效率和推理灵活性。

目标:主要目标是通过开发一个框架来解决现有 LLM 扩展策略的局限性,这些策略通常需要从头开始训练并激活固定规模的参数,该框架允许渐进式模型扩展、弹性推理以及更高效的 LLM 训练和调优。

成果:

完整论文:

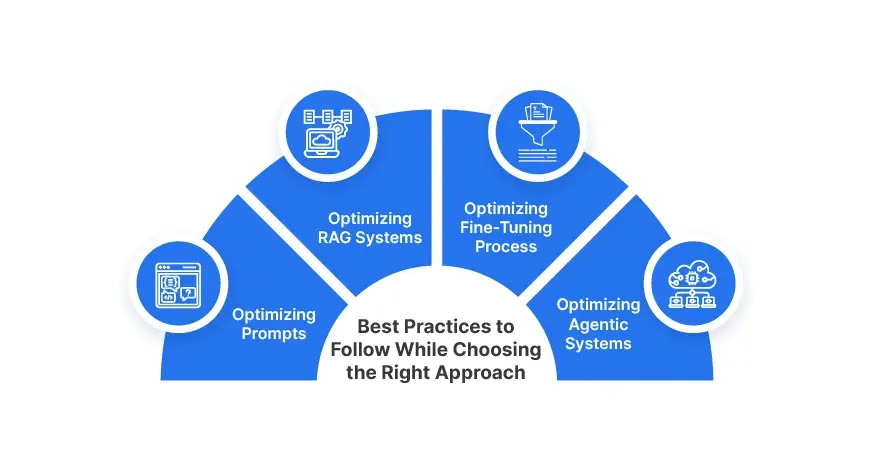

从所有这些 LLM 研究论文中可以得出的结论是,语言模型如今正被广泛应用于各种用途。它们的用例在很大程度上已经从文本生成(它最初的设计目标)转向了其他领域。这些研究基于围绕 LLM 开发的大量框架和协议。值得注意的是,大多数研究都集中在人工智能、机器学习和类似学科领域,因此,及时了解这些领域的动态就显得尤为重要。

现在,您可以利用最热门的 LLM 研究论文,整合其中的研究成果,从而创造最先进的成果。虽然其中大多数论文只是对现有技术进行了改进,但所取得的成果却带来了根本性的变革。这为蓬勃发展的语言模型领域的进一步研究和发展带来了光明的前景。

全部评论

留言在赶来的路上...

发表评论