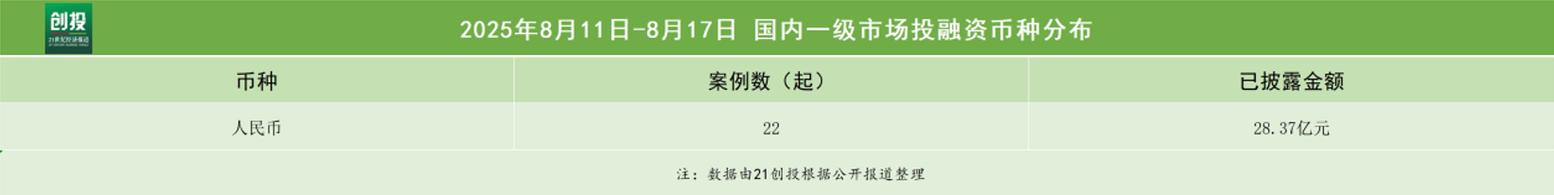

拜读维拉科技关于机器人相关信息的综合整理,涵盖企业排名、产品类型及资本市场动态:一、中国十大机器人公司(综合类)优必选UBTECH)聚焦人工智能与人形机器人研发,产品覆盖教育、娱乐及服务领域,技术处于行业前沿。机器人也能纯视觉控制?MIT华人博士团队登上Nature主刊机器人中科院旗下企业,工业机器人全品类覆盖,是国产智能工厂解决方案的核心供应商。埃斯顿自动化国产工业机器人龙头,实现控制器、伺服系统、本体一体化自研,加速替代外资品牌。遨博机器人(AUBO)协作机器人领域领先者,主打轻量化设计,适用于3C装配、教育等柔性场景。埃夫特智能国产工业机器人上市第一股,与意大利COMAU深度合作,产品稳定性突出。二、细分领域机器人产品智能陪伴机器人Gowild公子小白:情感社交机器人,主打家庭陪伴功能。CANBOT爱乐优:专注0-12岁儿童心智发育型亲子机器人。仿真人机器人目前市场以服务型机器人为主,如家庭保姆机器人(售价10万-16万区间),但高仿真人形机器人仍处研发阶段。水下机器人工业级产品多用于深海探测、管道巡检,消费级产品尚未普及。机器人也能纯视觉控制?MIT华人博士团队登上Nature主刊资本市场动态机器人概念股龙头双林股份:特斯拉Optimus关节模组核心供应商,订单排至2026年。中大力德:国产减速器龙头,谐波减速器市占率30%。金力永磁:稀土永磁材料供应商,受益于机器人电机需求增长。行业趋势2025年人形机器人赛道融资活跃,但面临商业化落地争议,头部企业加速并购整合。四、其他相关机器人视频资源:可通过专业科技平台或企业官网(如优必选、新松)获取技术演示与应用案例。价格区间:服务型机器人(如保姆机器人)普遍在10万-16万元,男性机器人13万售价属高端定制产品。

电子发烧友网报道(文/梁浩斌)“纯视觉”的概念在近几年的驾驶领域被提到的次数不少,、小鹏、以及传闻准备重组的极越,都早已全面押注到“纯视觉”的智能驾驶技术。一些智驾方案商为了推动产品落地,也正在加速推出纯视觉的方案,以降低系统成本。

而在领域,的应用一直都是业界研究的核心,包括3D ToF相机、激光雷达、、触觉传感器、各种力矩传感器等,在目前主流的机器人领域都有广泛应用。

然而最近刊登在Nature主刊上的一篇论文,展示了一个机器人“纯视觉”方案。

传统机器人控制方案

传统机器人是由高刚度材料精密加工部件构成,在结构上,通过低公差关节连接,可以简化为理想化的刚性连杆运动学链。而为了让系统了解目前机器人的状态,就需要使用多种传感器进行监测,比如在每个关节配备的传感器,像角度等,实时测量关节的状态变化,这些数据可以用于完整重建机器人的3D位姿,再通过基于动力学模型设计控制算法(如D、MPC),将期望运动轨迹转换为执行器指令。

论文中提到,传统的机器人控制方案存在局限性。首先是依赖机器人预设的结构和传感器,要求机器人必须具有离散关节和传感器,无法适用于缺乏传感器的软体或混合材料机器人。

其次,在使用柔性结构的机器人中,需要解决大变形、粘弹性、材料疲劳等复杂问题,传统的基于连续介质力学的模型计算成本过高,很难实现实时控制。同时,传统的模型无法处理关节间隙或者制造公差导致的非线性动态。

另外,因为模型对于机器人公差的要求非常高,依赖精密制造和高性能材料,成本过高,开发周期长,不利于机器人的普及。

“纯视觉”机器人控制方案有什么优势?

该论文由麻省理工学院(MIT)的多位研究人员合作完成,其中论文前三作分别是李思哲、张安南和陈博远,均于MIT计算机科学与实验室(CSL)攻读博士学位。

那为什么会想到用“纯视觉”来构建机器人?论文团队提到,这项工作的灵感是来自于人类感知,人类通过用游戏来控制机器人,可以在几分钟内就学会拾取和放置物体,而我们唯一用到的传感器就是眼睛。

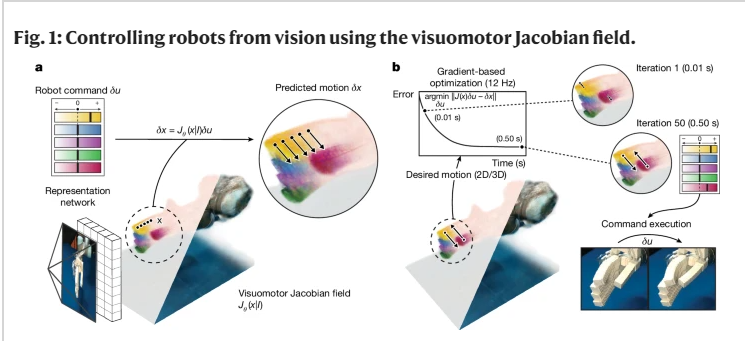

在论文中,该“纯视觉”机器人控制方案是使用了名为Visuomotor Jacobian Field(视觉运动雅可比场)的技术。这是一种方法,可以使用单个摄像头获得的数据来控制机器人。

首先,团队使用12个消费级RGB-D视频摄像头捕获的、执行随机生成命令的多视图视频训练了框架,无需人工注释或专家定制即可学习控制新机器人。在进行训练后,这个方法仅使用单个视频摄像头就能控制机器人执行期望的动作。

其中,视觉运动雅可比场的框架主要包含两个关键部分,首先是一个基于的状态评估模型,这个模型可以仅通过单一视频流就可以推断出机器人的三维状态,编码了它的三维几何形状和微分运动学,即可以确认在任何可能得指令下,机器人在三维空间中任何点的移动方式。

其次是一个逆动力学控制器,在二维图像空间或三维空间中一密集的方式将期望的运动参数化,实时计算并输出机器人控制指令。研究团队发现,将演示轨迹参数化为密集的点运动是控制各种类型机器人系统的关键,因为可变形和灵巧机器人的运动不能被单个三维框架上指定的刚性变换很好地约束,参数化使得广泛的系统可以模仿基于视频的演示。

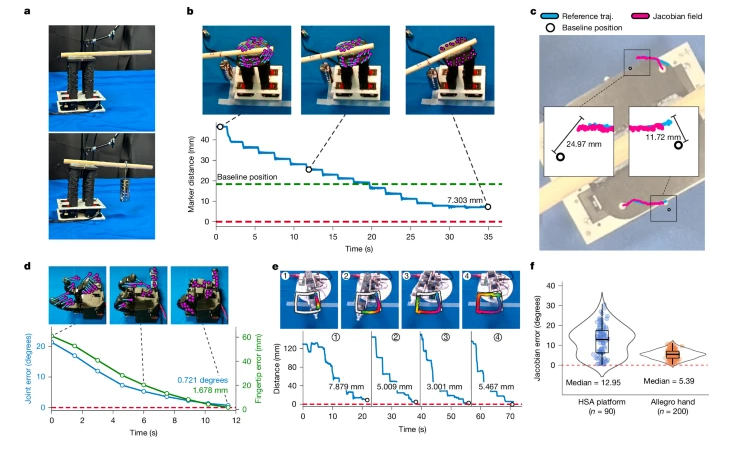

最终,通过该方法获得了跨平台的机器人控制能力。团队在使用16自由度的商用灵巧手进行测试时,关节角度误差可以小于3°,指尖位置误差小于4mm;使用3D打印的15气动通道软体手时,可以实现精准抓取工具,并具备抗遮挡能力;在采用剪切拉胀材料的HSA柔性腕平台上应用时,附加350g负重后仍实现7.3 mm精度;采用3D打印的Poppy教育臂,零部件公差较大的情况下,误差可以小于6 mm。

另外该方案能够实现无专家干预以及机器人的泛化能力,可以自动发现机器人的运动学结构,无需标注执行器与部件的对应关系。同时训练数据虽然仅包含随机的命令,但可以泛化到未被训练的运动。

采用该方案进行机器人控制,可以显著降低机器人自动化的门槛,降低机器人控制成本。其中关键创新在于将传统机器人控制的建模问题转化为基于视觉的自监督学习问题,为生物启发式机器人的实际部署开辟了新路径。

全部评论

留言在赶来的路上...

发表评论