腾讯联动

-

发布了文章 2个月前

ToonComposer – 腾讯联合港中文、北大推出的AI动画制作工具

ToonComposer 是香港中文大学、腾讯 PCG ARC 实验室和北京大学研究人员共同推出的生成式 AI 工具,几秒能将草图转化成专业级动画。ToonComposer基于生成式后关键帧技术,将传统动画制作中的中间帧生成...

-

发布了文章 2个月前

StableDrag – 腾讯联合南京大学推出的AI图像编辑框架

StableDrag是腾讯联合南京大学推出的AI图像编辑框架。让拖拽图片变得既稳又准,就像给图片装上了精准的GPS。无论你想怎么调整,StableDrag都能帮你准确无误地实现。通过点控制和手动拖拽,让图像编辑变得更加高效,...

-

发布了文章 2个月前

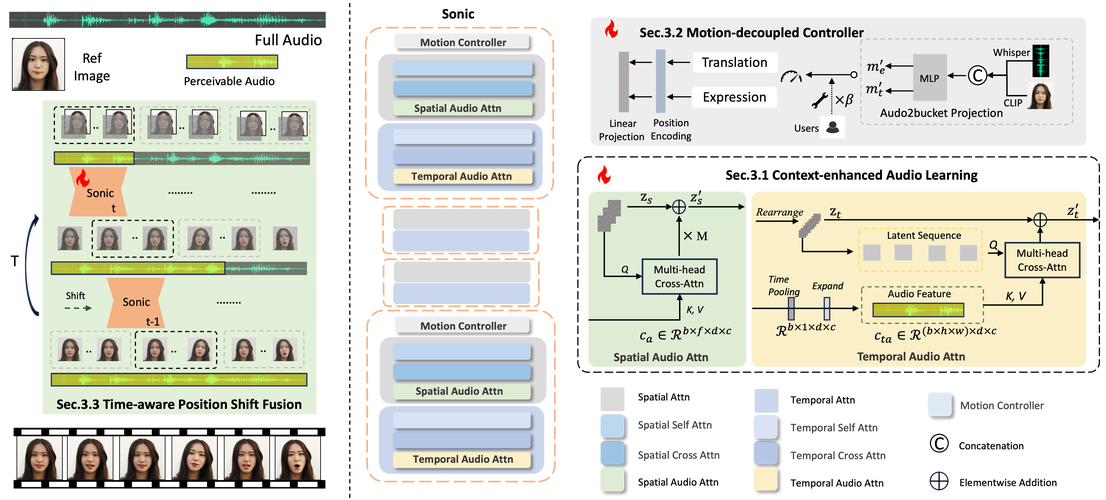

Sonic – 腾讯联合浙大推出的音频驱动肖像动画框架

Sonic是腾讯和浙江大学推出的音频驱动肖像动画框架,基于全局音频感知生成逼真的面部表情和动作。Sonic基于上下文增强音频学习和运动解耦控制器,分别提取音频片段内的长期时间音频知识和独立控制头部与表情运动,增强局部音频感知...

-

发布了文章 2个月前

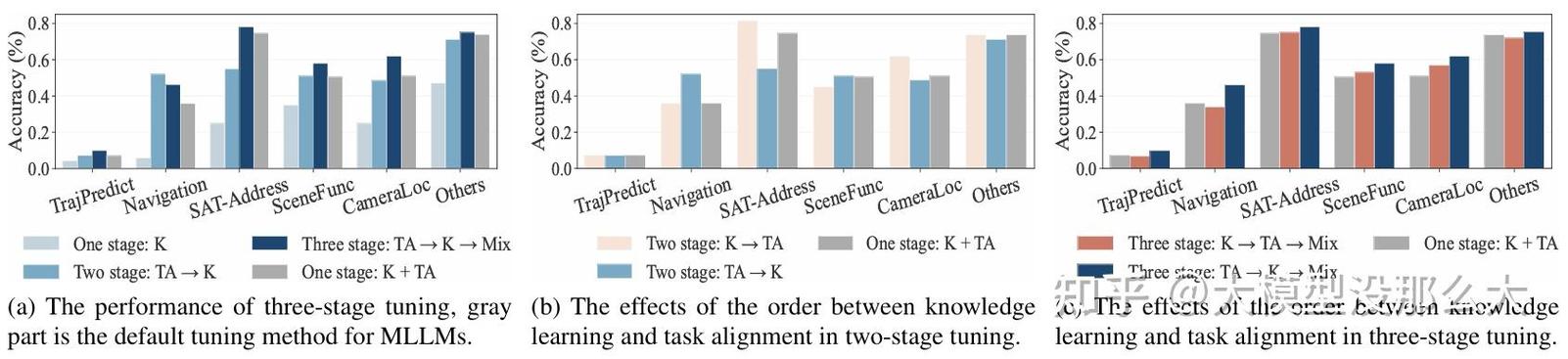

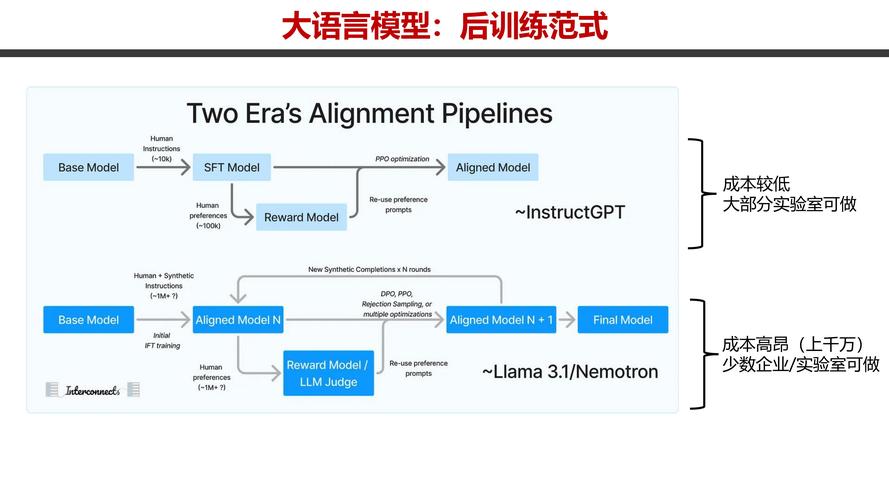

MindOmni – 腾讯联合清华等机构推出的多模态大语言模型

MindOmni 是腾讯 ARC Lab 联合清华大学深圳国际研究生院、香港中文大学和香港大学等推出的多模态大型语言模型,基于强化学习算法(RGPO)显著提升视觉语言模型的推理生成能力。模型用三阶段训练策略,首先构建统一视觉...

-

发布了文章 2个月前

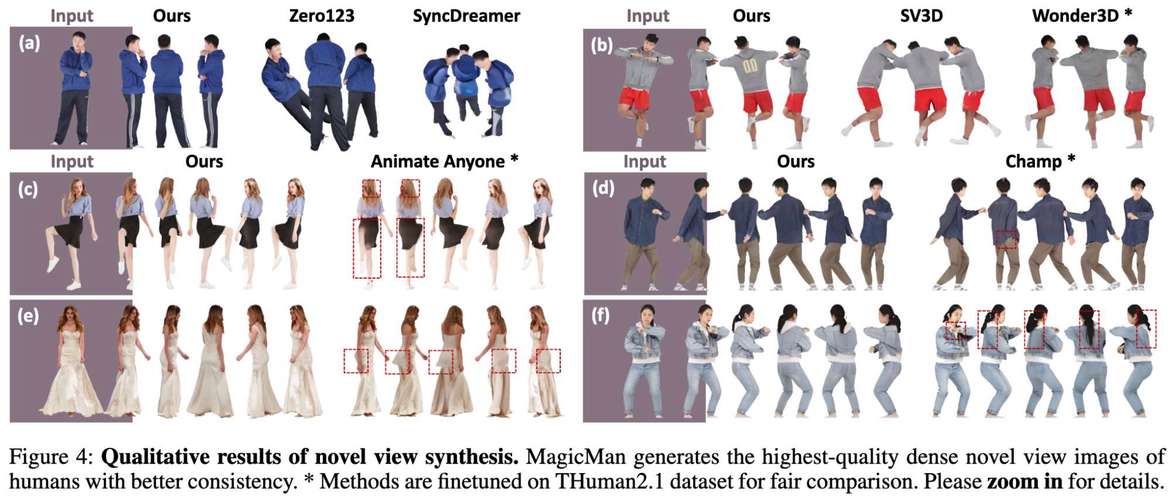

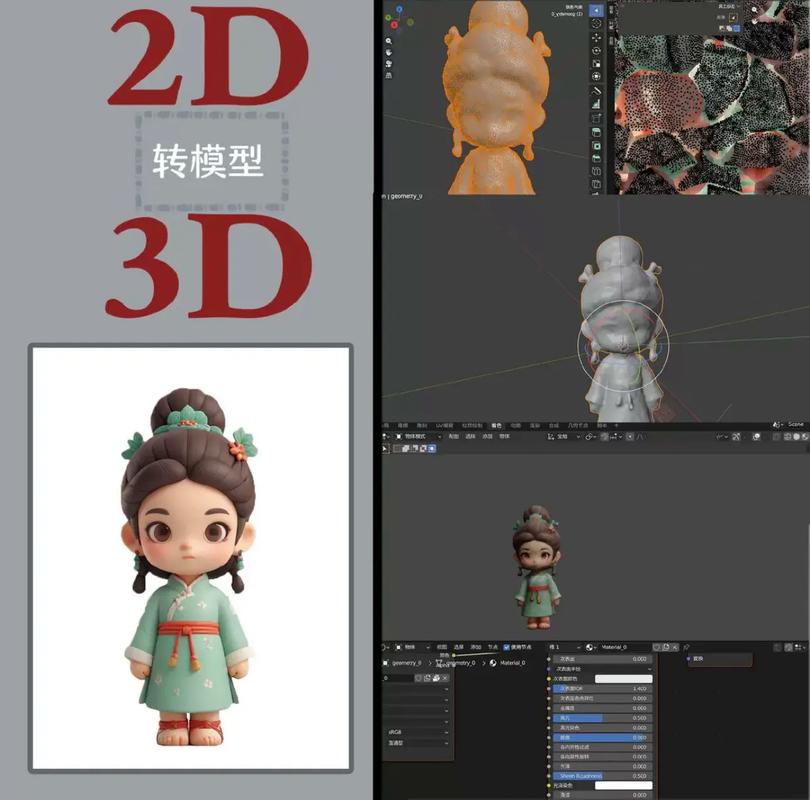

MagicMan – 腾讯联合多所高校推出2D图像生成3D人类模型的AI项目

MagicMan 是清华大学深圳国际研究生院、腾讯AI实验室、香港科技大学、斯坦福大学和香港中文大学的研究团队共同推出的AI项目,专注于基于深度学习技术从单张2D图像生成高质量的3D人类模型。...

-

发布了文章 2个月前

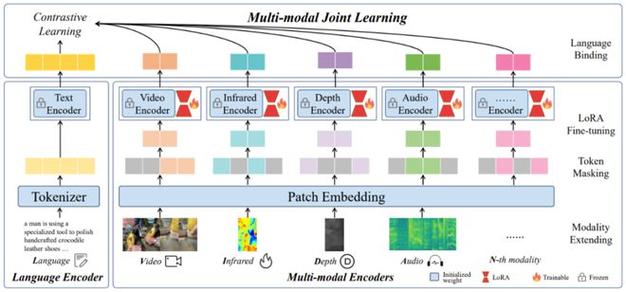

M2UGen – 腾讯联合国立大学推出多模态音乐理解和生成框架

M2UGen是先进的多模态音乐理解和生成框架,由腾讯PCG ARC实验室与新加坡国立大学联合推出。结合了大型语言模型(LLM)的能力,能处理包括文本、图像、视频和音频在内的多模态输入,生成相应的音乐。...

-

发布了文章 2个月前

LVCD – 腾讯联合香港城市大学推出为动漫视频线稿上色的AI框架

LVCD(Large Video Color Diffusion)是一个专为动画视频线稿上色设计的视频扩散框架,能将黑白线稿自动转化为彩色动画视频。LVCD使用了一种先进的扩散模型,可以同时处理整个视频序列,保证每一帧的颜色...

-

发布了文章 2个月前

FitDiT – 腾讯联合复旦推出的高保真虚拟试穿技术

FitDiT是高保真虚拟试穿技术,是腾讯和复旦大学联合推出的。基于Diffusion Transformers(DiT)关注高分辨率特征,提升服装细节的呈现。FitDiT用服装纹理提取器和服装先验演化技术,增强对服装纹理如条...

-

发布了文章 2个月前

CustomCrafter – 腾讯联合浙大推出的自定义视频生成框架

CustomCrafter 是腾讯和浙江大学联合提出的自定义视频生成框架,能基于文本提示和参考图像生成高质量的个性化视频,同时保留了运动生成和概念组合的能力。CustomCrafter通过设计一系列灵活的模块,实现了无需额外...

-

发布了文章 2个月前

AnimeGamer – 腾讯联合香港城市大学推出的动漫生活模拟系统

AnimeGamer 是腾讯 PCG 和香港城市大学共同推出的无限动漫生活模拟系统。基于多模态大语言模型(MLLM),支持玩家基于开放式的语言指令,用动漫角色的身份沉浸于动态游戏世界中。...

没有更多内容